GSP1158

Panoramica

Dataplex Universal Catalog è un data fabric intelligente che consente alle organizzazioni di centralizzare l'individuazione, la gestione, il monitoraggio e la governance dei dati in data lake, data warehouse e data mart per potenziare l'analisi su larga scala.

Una funzionalità importante di Dataplex Universal Catalog è la capacità di definire ed eseguire controlli sulla qualità dei dati per i suoi asset, come le tabelle di BigQuery e i file di Cloud Storage. Utilizzando le attività di qualità dei dati di Dataplex, puoi integrare i controlli di qualità dei dati nei workflow quotidiani convalidando i dati che fanno parte di una pipeline di produzione di dati, monitorando regolarmente la qualità dei dati rispetto a un set di criteri e creando report sulla qualità dei dati per i requisiti normativi.

In questo lab imparerai a valutare la qualità dei dati con Dataplex Universal Catalog. Per farlo, creerai un file di specifiche personalizzato per la qualità dei dati e lo userai per definire ed eseguire un job di controllo qualità sui dati BigQuery.

In questo lab proverai a:

- Creare un lake, una zona e un asset in Dataplex Universal Catalog

- Eseguire query su una tabella BigQuery per controllare la qualità dei dati

- Creare e caricare un file di specifiche della qualità dei dati

- Definire ed eseguire un job di qualità dei dati

- Esaminare i risultati di un job di qualità dei dati

Configurazione e requisiti

Prima di fare clic sul pulsante Avvia lab

Leggi le seguenti istruzioni. I lab sono a tempo e non possono essere messi in pausa. Il timer si avvia quando fai clic su Inizia il lab e ti mostra per quanto tempo avrai a disposizione le risorse Google Cloud.

Con questo lab pratico avrai la possibilità di completare le attività in un ambiente cloud reale e non di simulazione o demo. Riceverai delle nuove credenziali temporanee che potrai utilizzare per accedere a Google Cloud per la durata del lab.

Per completare il lab, avrai bisogno di:

- Accesso a un browser internet standard (Chrome è il browser consigliato).

Nota: per eseguire questo lab, utilizza una finestra del browser in modalità di navigazione in incognito (consigliata) o privata. Ciò evita conflitti tra il tuo account personale e l'account studente, che potrebbero causare addebiti aggiuntivi sul tuo account personale.

- È ora di completare il lab: ricorda che, una volta iniziato, non puoi metterlo in pausa.

Nota: utilizza solo l'account studente per questo lab. Se utilizzi un altro account Google Cloud, potrebbero essere addebitati costi su quell'account.

Come avviare il lab e accedere alla console Google Cloud

-

Fai clic sul pulsante Avvia lab. Se devi effettuare il pagamento per il lab, si aprirà una finestra di dialogo per permetterti di selezionare il metodo di pagamento.

A sinistra, trovi il riquadro Dettagli lab con le seguenti informazioni:

- Il pulsante Apri la console Google Cloud

- Tempo rimanente

- Credenziali temporanee da utilizzare per il lab

- Altre informazioni per seguire questo lab, se necessario

-

Fai clic su Apri console Google Cloud (o fai clic con il tasto destro del mouse e seleziona Apri link in finestra di navigazione in incognito se utilizzi il browser Chrome).

Il lab avvia le risorse e apre un'altra scheda con la pagina di accesso.

Suggerimento: disponi le schede in finestre separate posizionate fianco a fianco.

Nota: se visualizzi la finestra di dialogo Scegli un account, fai clic su Usa un altro account.

-

Se necessario, copia il Nome utente di seguito e incollalo nella finestra di dialogo di accesso.

{{{user_0.username | "Username"}}}

Puoi trovare il Nome utente anche nel riquadro Dettagli lab.

-

Fai clic su Avanti.

-

Copia la Password di seguito e incollala nella finestra di dialogo di benvenuto.

{{{user_0.password | "Password"}}}

Puoi trovare la Password anche nel riquadro Dettagli lab.

-

Fai clic su Avanti.

Importante: devi utilizzare le credenziali fornite dal lab. Non utilizzare le credenziali del tuo account Google Cloud.

Nota: utilizzare il tuo account Google Cloud per questo lab potrebbe comportare addebiti aggiuntivi.

-

Fai clic nelle pagine successive:

- Accetta i termini e le condizioni.

- Non inserire opzioni di recupero o l'autenticazione a due fattori, perché si tratta di un account temporaneo.

- Non registrarti per le prove gratuite.

Dopo qualche istante, la console Google Cloud si apre in questa scheda.

Nota: per accedere ai prodotti e ai servizi Google Cloud, fai clic sul menu di navigazione o digita il nome del servizio o del prodotto nel campo Cerca.

Attiva Cloud Shell

Cloud Shell è una macchina virtuale in cui sono caricati strumenti per sviluppatori. Offre una home directory permanente da 5 GB e viene eseguita su Google Cloud. Cloud Shell fornisce l'accesso da riga di comando alle risorse Google Cloud.

-

Fai clic su Attiva Cloud Shell  nella parte superiore della console Google Cloud.

nella parte superiore della console Google Cloud.

-

Fai clic nelle seguenti finestre:

- Continua nella finestra delle informazioni di Cloud Shell.

- Autorizza Cloud Shell a utilizzare le tue credenziali per effettuare chiamate API Google Cloud.

Quando la connessione è attiva, l'autenticazione è già avvenuta e il progetto è impostato sul tuo Project_ID, . L'output contiene una riga che dichiara il Project_ID per questa sessione:

Your Cloud Platform project in this session is set to {{{project_0.project_id | "PROJECT_ID"}}}

gcloud è lo strumento a riga di comando di Google Cloud. È preinstallato su Cloud Shell e supporta il completamento tramite tasto Tab.

- (Facoltativo) Puoi visualizzare il nome dell'account attivo con questo comando:

gcloud auth list

- Fai clic su Autorizza.

Output:

ACTIVE: *

ACCOUNT: {{{user_0.username | "ACCOUNT"}}}

To set the active account, run:

$ gcloud config set account `ACCOUNT`

- (Facoltativo) Puoi elencare l'ID progetto con questo comando:

gcloud config list project

Output:

[core]

project = {{{project_0.project_id | "PROJECT_ID"}}}

Nota: per la documentazione completa di gcloud, in Google Cloud, fai riferimento alla guida Panoramica dell'interfaccia a riga di comando gcloud.

Abilita l'API Dataproc

-

Nella console Google Cloud, inserisci API Cloud Dataproc nella barra di ricerca in alto.

-

Fai clic sul risultato per API Cloud Dataproc in Marketplace.

-

Fai clic su Abilita.

Attività 1: crea un lake, una zona e un asset in Dataplex

Per definire ed eseguire attività di qualità dei dati, è necessario innanzitutto creare alcune risorse Dataplex Universal Catalog.

In questa attività creerai un nuovo lake Dataplex Universal Catalog per archiviare le informazioni sui clienti di e-commerce, aggiungerai una zona grezza al lake e poi collegherai un set di dati BigQuery creato in precedenza come nuovo asset nella zona.

Crea un lake

- Nella console Google Cloud, nel menu di navigazione (

) > Visualizza tutti i prodotti, vai ad Analisi > Dataplex Universal Catalog.

) > Visualizza tutti i prodotti, vai ad Analisi > Dataplex Universal Catalog.

Se viene visualizzato Ti diamo il benvenuto nel nuovo Dataplex Universal Catalog, fai clic su Chiudi.

-

In Gestisci lake, fai clic su Gestisci.

-

Fai clic su Crea lake.

-

Inserisci le informazioni richieste per creare un nuovo lake:

| Proprietà |

Valore |

| Nome visualizzato |

Ecommerce Lake |

| ID |

Lascia il valore predefinito. |

| Regione |

|

Lascia invariati gli altri valori predefiniti.

- Fai clic su Crea.

La creazione del lake può richiedere fino a 3 minuti.

Aggiungi una zona al lake

-

Nella scheda Gestisci, fai clic sul nome del tuo lake.

-

Fai clic su +AGGIUNGI ZONA.

-

Inserisci le informazioni richieste per creare una nuova zona:

| Proprietà |

Valore |

| Nome visualizzato |

Customer Contact Raw Zone |

| ID |

Lascia il valore predefinito. |

| Tipo |

Zona grezza |

| Località dei dati |

A livello di regione |

Lascia invariati gli altri valori predefiniti.

Ad esempio, l'opzione Attiva rilevamento metadati in Impostazioni di rilevamento è abilitata per impostazione predefinita e consente agli utenti autorizzati di rilevare i dati nella zona.

- Fai clic su Crea.

La creazione della zona può richiedere fino a 2 minuti.

Nota: puoi eseguire l'attività successiva una volta che lo stato della zona è Attivo.

Collega un asset a una zona

-

Nella scheda Zone, fai clic sul nome della tua zona.

-

Nella scheda Asset, fai clic su +AGGIUNGI ASSET.

-

Fai clic su Aggiungi un asset.

-

Inserisci le informazioni richieste per collegare un nuovo asset:

| Proprietà |

Valore |

| Tipo |

Set di dati BigQuery |

| Nome visualizzato |

Contact Info |

| ID |

Lascia il valore predefinito. |

| Set di dati |

.customers |

Lascia invariati gli altri valori predefiniti.

-

Fai clic su Fine.

-

Fai clic su Continua.

-

Per Impostazioni di rilevamento, seleziona Eredita per ereditare le impostazioni di rilevamento dal livello di zona, quindi fai clic su Continua.

-

Fai clic su Invia.

Fai clic su Controlla i miei progressi per verificare l'obiettivo.

Crea un lake, una zona e un asset in Dataplex Universal Catalog

Attività 2: esegui query su una tabella BigQuery per controllare la qualità dei dati

Nell'attività precedente, hai creato un nuovo asset Dataplex Universal Catalog da un set di dati BigQuery denominato customers, pre-creato appositamente per questo lab. Questo set di dati contiene una tabella denominata contact_info che contiene dati di contatto non elaborati per i clienti di un'azienda di e-commerce fittizia.

In questa attività, eseguirai una query su questa tabella per iniziare a identificare alcuni potenziali problemi di qualità dei dati che puoi includere come controlli in un job di qualità dei dati. Identificherai inoltre un altro set di dati creato in precedenza che potrai utilizzare per archiviare i risultati del job di qualità dei dati in un'attività successiva.

-

Nella console Google Cloud, nel menu di navigazione ( ), vai a BigQuery.

), vai a BigQuery.

-

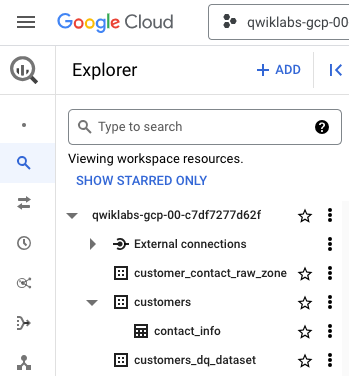

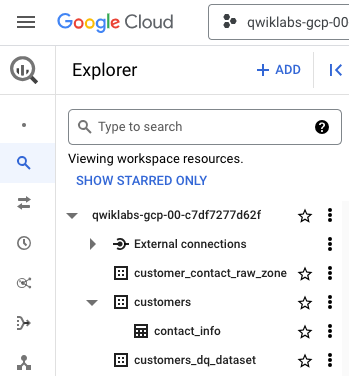

Nel riquadro Explorer, espandi la freccia accanto all'ID progetto per elencarne i contenuti:

Oltre al set di dati customer_contact_raw_zone creato da Dataplex Universal Catalog per gestire quella zona, esistono due set di dati BigQuery creati in precedenza per questo lab:

- customers

- customers_dq_dataset

Il set di dati customers contiene una tabella denominata contact_info, che include i dati di contatto per i clienti come ID cliente, nome, email e altro. Questa è la tabella che esplorerai e controllerai per trovare eventuali problemi di qualità dei dati durante questo lab.

Il set di dati denominato customers_dq_dataset non contiene tabelle. Quando definirai un job di qualità dei dati in un'attività successiva, utilizzerai questo set di dati come destinazione per una nuova tabella contenente i risultati del job di qualità dei dati.

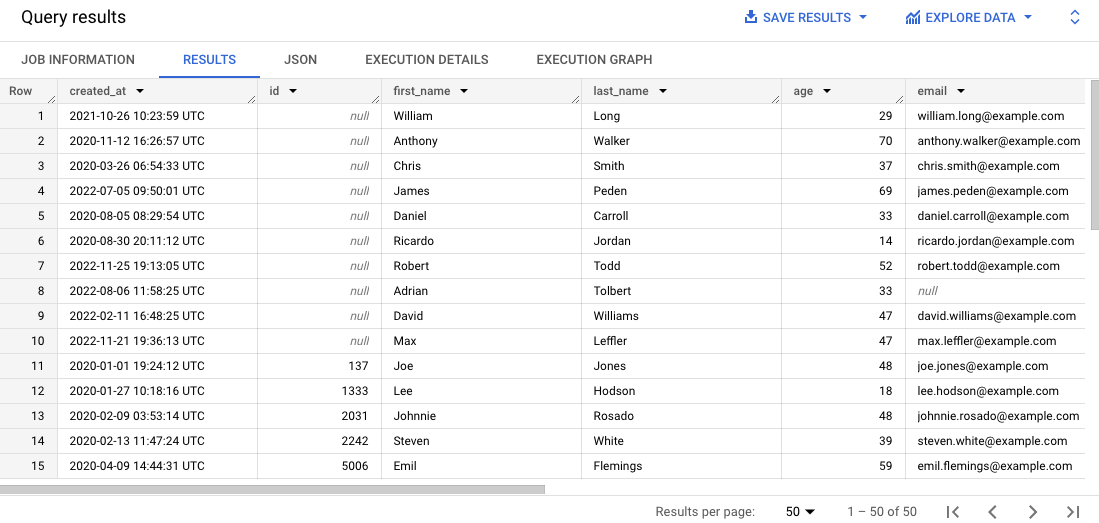

- Nell'Editor SQL, fai clic su + Query SQL. Incolla questa query, quindi fai clic su Esegui:

SELECT * FROM `{{{project_0.project_id}}}.customers.contact_info`

ORDER BY id

LIMIT 50

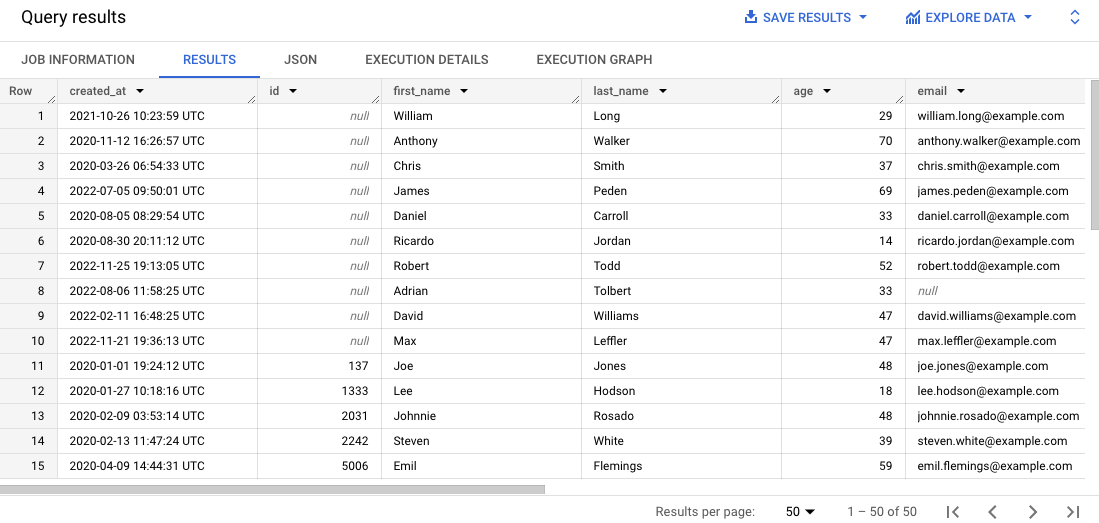

Questa query seleziona 50 record dalla tabella originale e ordina i record in base all'ID cliente nei risultati.

- Scorri i risultati nel riquadro Risultati.

Nota che alcuni record sono privi degli ID cliente o hanno indirizzi email errati, cosa che può complicare la gestione degli ordini dei clienti.

Fai clic su Controlla i miei progressi per verificare l'obiettivo.

Esegui query su una tabella BigQuery per controllare la qualità dei dati

Attività 3: crea e carica un file di specifiche della qualità dei dati

I requisiti di controllo della qualità dei dati Dataplex vengono definiti utilizzando i file delle specifiche YAML di CloudDQ. Una volta creato, il file delle specifiche YAML viene caricato in un bucket Cloud Storage reso accessibile al job di qualità dei dati.

Il file YAML ha quattro sezioni chiave:

- un elenco di regole da eseguire (regole predefinite o personalizzate)

- filtri di riga per selezionare un sottoinsieme di dati per la convalida

- associazioni di regole per applicare le regole definite alle tabelle

- dimensioni delle regole facoltative per specificare i tipi di regole che il file YAML può contenere

In questa attività definirai un nuovo file di specifiche YAML per i controlli della qualità dei dati che identificano ID cliente ed email null nella tabella BigQuery specificata. Dopo aver definito il file, caricalo in un bucket Cloud Storage creato in precedenza per utilizzarlo in un'attività successiva ed eseguire il job di qualità dei dati.

Crea il file delle specifiche della qualità dei dati

- In Cloud Shell, esegui il comando seguente per creare un nuovo file vuoto per la specifica della qualità dei dati:

nano dq-customer-raw-data.yaml

- Incolla il seguente codice:

metadata_registry_defaults:

dataplex:

projects: {{{project_0.project_id | Project ID}}}

locations: {{{project_0.default_region | Region}}}

lakes: ecommerce-lake

zones: customer-contact-raw-zone

row_filters:

NONE:

filter_sql_expr: |-

True

INTERNATIONAL_ITEMS:

filter_sql_expr: |-

REGEXP_CONTAINS(item_id, 'INTNL')

rule_dimensions:

- consistency

- correctness

- duplication

- completeness

- conformance

- integrity

- timeliness

- accuracy

rules:

NOT_NULL:

rule_type: NOT_NULL

dimension: completeness

VALID_EMAIL:

rule_type: REGEX

dimension: conformance

params:

pattern: |-

^[^@]+[@]{1}[^@]+$

rule_bindings:

VALID_CUSTOMER:

entity_uri: bigquery://projects/{{{project_0.project_id | Project ID}}}/datasets/customers/tables/contact_info

column_id: id

row_filter_id: NONE

rule_ids:

- NOT_NULL

VALID_EMAIL_ID:

entity_uri: bigquery://projects/{{{project_0.project_id | Project ID}}}/datasets/customers/tables/contact_info

column_id: email

row_filter_id: NONE

rule_ids:

- VALID_EMAIL

- Esamina il codice per identificare le due regole principali sulla qualità dei dati definite in questo file.

Il file dq-customer-raw-data.yaml inizia con i parametri chiave per identificare le risorse Dataplex Universal Catalog, inclusi l'ID progetto, la regione e i nomi del lake e della zona Dataplex Universal Catalog.

Successivamente, specifica le dimensioni consentite delle regole e due regole principali:

- La regola per i valori NOT_NULL si riferisce alla dimensione di completezza come i valori null.

- La regola per i valori VALID_EMAIL si riferisce alla dimensione di conformità come i valori non validi.

Infine, le regole sono associate a entità (tabelle) e colonne utilizzando associazioni di regole per la convalida della qualità dei dati:

- La prima associazione di regole denominata VALID_CUSTOMER associa la regola NOT_NULL alla colonna id della tabella contact_info, che verrà convalidata se la colonna ID ha valori NULL.

- La seconda associazione di regole denominata VALID_EMAIL_ID associa la regola VALID_EMAIL alla colonna email della tabella contact_info, che controllerà le email valide.

- Inserisci

Ctrl+X, quindi Y, per salvare e chiudere il file.

Carica il file su Cloud Storage

- In Cloud Shell, esegui questo comando per caricare il file in un bucket Cloud Storage creato per questo lab:

gsutil cp dq-customer-raw-data.yaml gs://{{{project_0.project_id | Project ID}}}-bucket

Fai clic su Controlla i miei progressi per verificare l'obiettivo.

Crea e carica un file di specifiche della qualità dei dati

Attività 4: definisci ed esegui un job di qualità dei dati in Dataplex

Il job di qualità dei dati utilizza un file YAML delle specifiche della qualità dei dati per eseguire un job di qualità dei dati e genera metriche sulla qualità dei dati che vengono scritte in un set di dati BigQuery.

In questa attività definirai ed eseguirai un job di qualità dei dati utilizzando il file YAML delle specifiche della qualità dei dati caricato su Cloud Storage nell'attività precedente. Quando definirai il job, specificherai anche un set di dati BigQuery creato in precedenza denominato customer_dq_dataset per archiviare i risultati sulla qualità dei dati.

-

Nella console Google Cloud, nel menu di navigazione ( ) > Visualizza tutti i prodotti, vai ad Analisi > Dataplex Universal Catalog.

) > Visualizza tutti i prodotti, vai ad Analisi > Dataplex Universal Catalog.

-

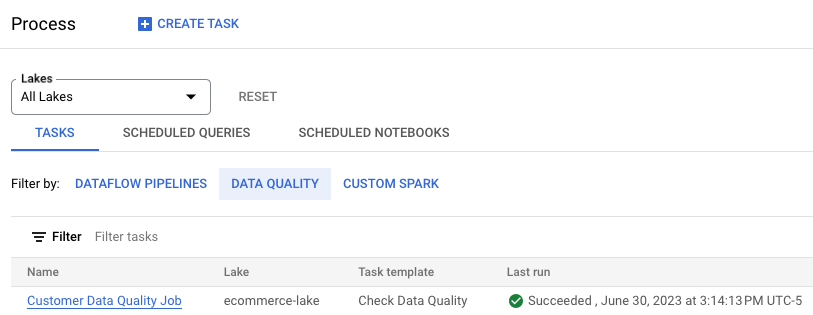

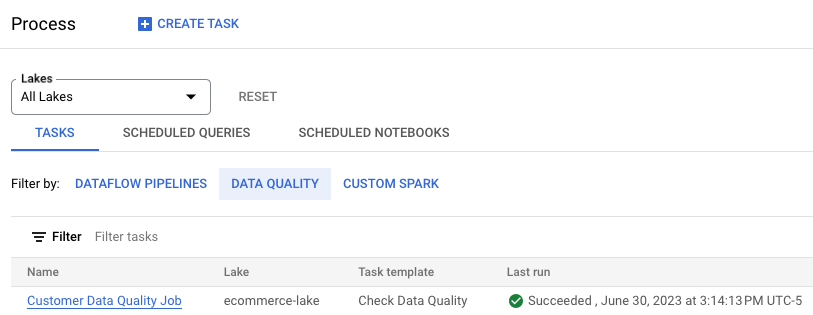

In Gestisci lake, fai clic su Elabora.

-

Fai clic su +CREA ATTIVITÀ.

-

In Controlla la qualità dei dati, fai clic su Crea attività.

-

Inserisci le informazioni richieste per creare un nuovo job di qualità dei dati:

| Proprietà |

Valore |

| Lake Dataplex |

ecommerce-lake |

| Nome visualizzato |

Customer Data Quality Job |

| ID |

Lascia il valore predefinito. |

| Seleziona file GCS |

-bucket/dq-customer-raw-data.yaml |

| Seleziona set di dati BigQuery |

.customers_dq_dataset |

| Tabella BigQuery |

dq_results |

| Service account utente |

Service account predefinito Compute Engine |

Lascia invariati gli altri valori predefiniti.

Tieni presente che il service account predefinito di Compute Engine è stato preconfigurato per questo lab in modo da avere i ruoli e le autorizzazioni IAM appropriati. Per saperne di più, consulta la documentazione di Dataplex Universal Catalog Crea un service account.

-

Fai clic su Continua.

-

Per Inizia, seleziona Immediatamente.

-

Fai clic su Crea.

Nota: l'esecuzione del job può richiedere diversi minuti. Per vedere se il job è stato eseguito correttamente, potresti dover aggiornare la pagina.

Fai clic su Controlla i miei progressi per verificare l'obiettivo.

Definisci ed esegui un job di qualità dei dati in Dataplex Universal Catalog

Attività 5: esamina i risultati sulla qualità dei dati in BigQuery

In questa attività, esaminerai le tabelle in customers_dq_dataset per identificare i record privi dei valori ID cliente o contenenti valori non validi per le email.

-

Nella console Google Cloud, nel menu di navigazione ( ), vai a BigQuery.

), vai a BigQuery.

-

Nel riquadro Explorer, espandi la freccia accanto all'ID progetto per elencarne i contenuti:

-

Espandi la freccia accanto al set di dati customer_dq_dataset.

-

Fai clic sulla tabelladq_summary.

-

Fai clic sulla scheda Anteprima per vedere i risultati.

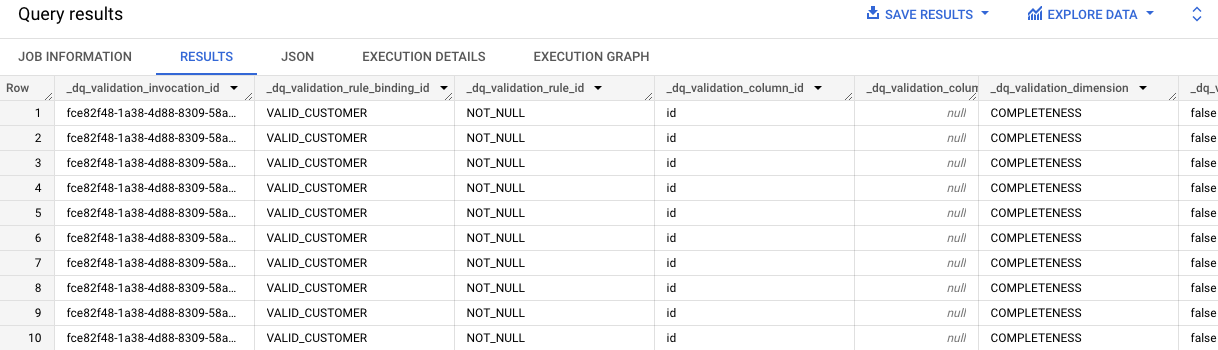

La tabella di dq_summary fornisce informazioni utili sulla qualità complessiva dei dati, compreso il numero di record identificati come non conformi alle due regole nel file delle specifiche della qualità dei dati.

-

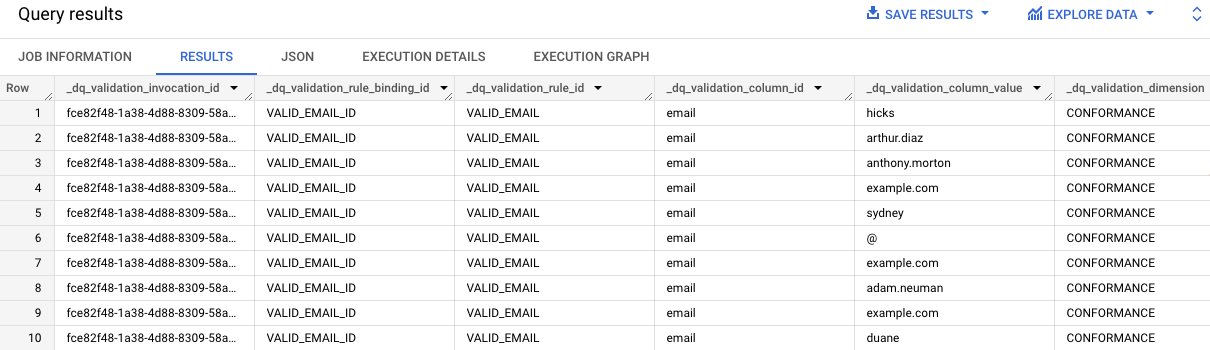

Scorri fino all'ultima colonna denominata failed_records_query.

-

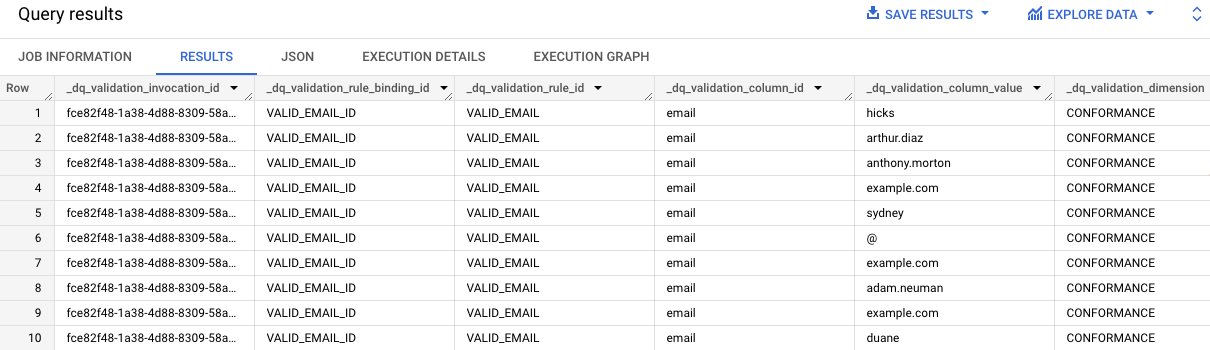

Fai clic sulla Freccia giù nella prima riga per espandere il testo e visualizzare l'intera query per i risultati della regola VALID_EMAIL.

Nota: la query è piuttosto lunga e termina con ORDER BY _dq_validation_rule_id.

- Fai clic su + Query SQL. Copia e incolla la query nell'Editor SQL e fai clic su Esegui.

I risultati della query forniscono i valori email della tabella contact_info che non sono validi.

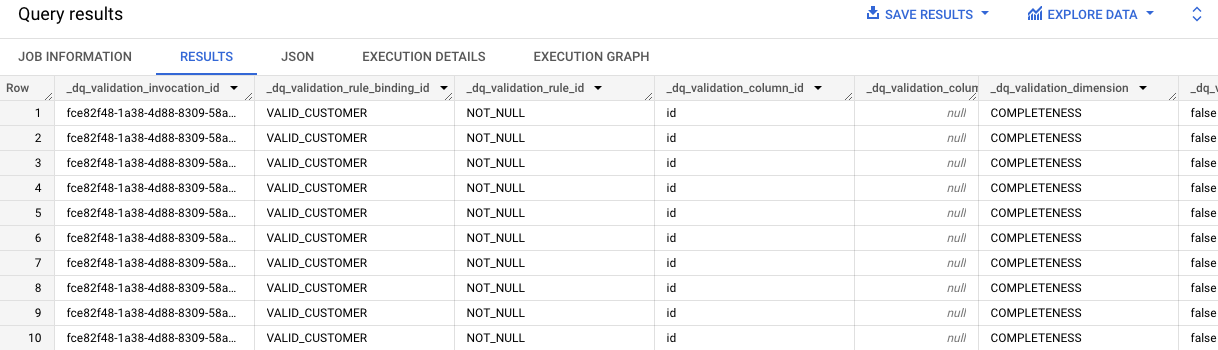

- Ripeti i passaggi 7-8 per la seconda cella che contiene la query per i risultati della regola VALID_CUSTOMER.

Dai risultati della query emerge che nella tabella contact_info sono presenti 10 record privi dei valori ID.

Fai clic su Controlla i miei progressi per verificare l'obiettivo.

Esamina i risultati sulla qualità dei dati nella tabella BigQuery

Complimenti!

Hai valutato la qualità dei dati con Dataplex Universal Catalog. Per farlo, hai creato un file di specifiche personalizzato della qualità dei dati e lo hai usato per eseguire un job di qualità dei dati su una tabella BigQuery.

Formazione e certificazione Google Cloud

… per utilizzare al meglio le tecnologie Google Cloud. I nostri corsi ti consentono di sviluppare competenze tecniche e best practice per aiutarti a metterti subito al passo e avanzare nel tuo percorso di apprendimento. Offriamo vari livelli di formazione, dal livello base a quello avanzato, con opzioni di corsi on demand, dal vivo e virtuali, in modo da poter scegliere il più adatto in base ai tuoi impegni. Le certificazioni ti permettono di confermare e dimostrare le tue abilità e competenze relative alle tecnologie Google Cloud.

Ultimo aggiornamento del manuale: 4 giugno 2025

Ultimo test del lab: 4 giugno 2025

Copyright 2025 Google LLC. Tutti i diritti riservati. Google e il logo Google sono marchi di Google LLC. Tutti gli altri nomi di società e prodotti sono marchi delle rispettive società a cui sono associati.

nella parte superiore della console Google Cloud.

nella parte superiore della console Google Cloud. ) > Visualizza tutti i prodotti, vai ad Analisi > Dataplex Universal Catalog.

) > Visualizza tutti i prodotti, vai ad Analisi > Dataplex Universal Catalog.